Контроль за суперинтеллектом: ограничения во имя безопасности

- 6 мар. 2017 г.

- 1 мин. чтения

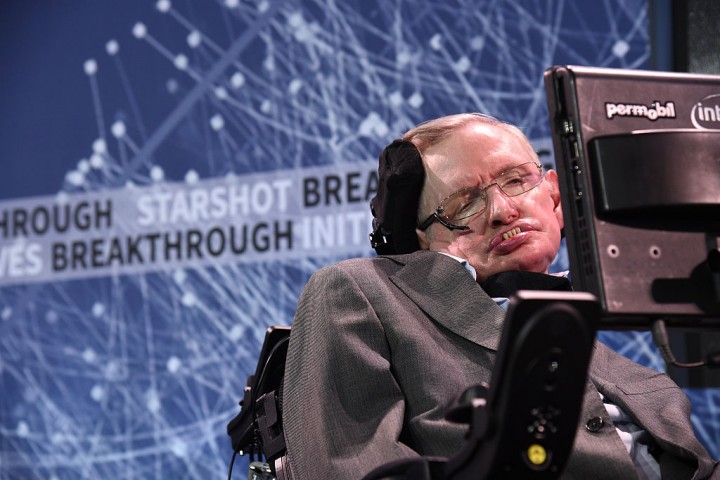

Основатель Tesla Motors Илон Маск и физик-теоретик Стивен Хокинг одобрили принципы безопасной работы с искусственным интеллектом

В будущем искусственный интеллект станет незаменимым помощником и главным козырем в борьбе со многими ныне неразрешимыми проблемами человечества. Например, в лечении неизлечимых болезней или разрешении экологических проблем. Тем не менее, как и любое высокотехнологичное достижение, ИИ требует контроля.

При всех своих достоинствах искусственный интеллект несет в себе ряд угроз. По убеждению Маска потенциальная опасность искусственного интеллекта выше, чем у ядерного оружия, а Хокинг заявляет, что ИИ может нанести непоправимый вред человечеству.

Как и в случае с ядерным оружием людям необходимо договориться о допустимых сферах применения искусственного интеллекта. Именно для этой цели был заключен пакт, фиксирующий основные положения безопасной работы с ИИ.

23 принципа работы с искусственным интеллектом были разработаны на конференции в Калифорнии в начале января 2017 года. По замыслу разработчиков следование этим принципам обеспечит выгодную эксплуатацию ИИ и ее безопасность для людей.

Принципы разделены на три части: исследовательские вопросы, этика и ценности и долгосрочные проблемы. В первом разделе прописаны принципы прозрачности исследований, стандартов безопасности и условий финансирования. Сквозь все пункты красной нитью проходит принцип благих целей исследователей и разработчиков. Во второй части речь идет о контроле человека над результатами разработок, о широком применении разработанных технологий, о безопасности, о контроле над обрабатываемой ИИ информацией и др. В последнем разделе принципов зафиксированы вопросы рисков, исторической важности открытия суперинтеллекта и общечеловеческого пользования результатами разработок.

Комментарии